Más de 200 empleados de Google DeepMind firmaron una carta interna dirigida a Jeff Dean, Chief Scientist de Google, pidiendo que la empresa establezca líneas rojas claras para el uso militar de la IA.

¿Qué piden?

La carta se opone específicamente a:

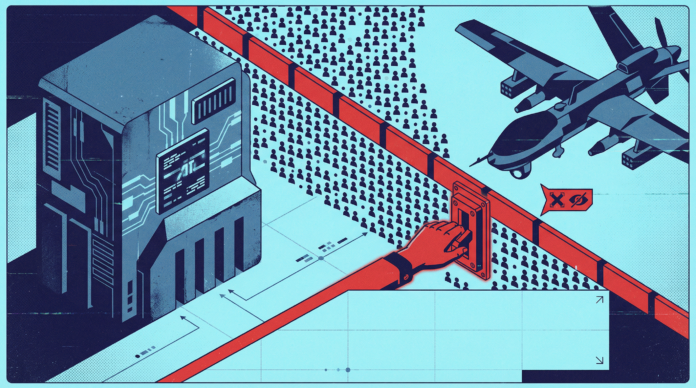

- Vigilancia masiva de ciudadanos usando sistemas de IA

- Armas autónomas sin supervisión humana

- Cualquier uso de Gemini (el modelo de IA de Google) para aplicaciones militares clasificadas

El contexto

La carta llega en un momento crítico: Anthropic está negociando con el Pentágono para usar Claude en sistemas de inteligencia clasificados. Google tiene contratos militares activos a través de Google Cloud. Y el gobierno de EE.UU. está acelerando la adopción de IA en defensa.

Aprende IA con nosotros

Únete gratis a mi comunidad en Skool, donde compartimos noticias, tutoriales y recursos para seguir aprendiendo juntos.

👥 Únete gratis 🚀No es la primera vez que empleados de Google se oponen a contratos militares — en 2018, el proyecto Maven (drones con IA) generó una revuelta interna que llevó a Google a cancelar el contrato. Pero esta vez las apuestas son más altas y la tecnología, mucho más poderosa.

El dilema ético de la IA

La tensión es real: las mismas empresas que desarrollan IA para productividad, salud y educación están siendo cortejadas por gobiernos que quieren IA para defensa y vigilancia. ¿Dónde se traza la línea?

Fuentes: New York Times · The Week