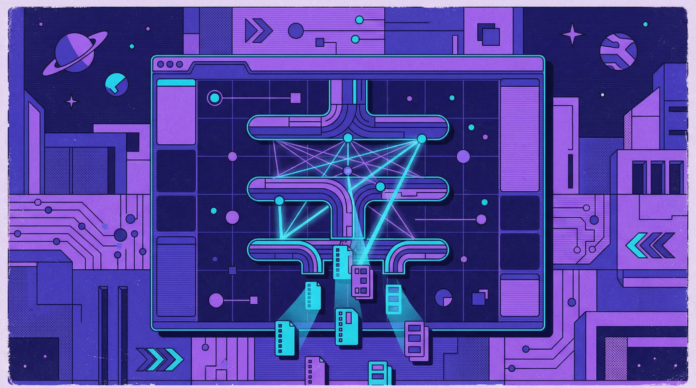

GPT-2 corriendo en tu navegador. Cada token que se procesa, cada capa de atención activándose, la probabilidad de la siguiente palabra actualizándose en tiempo real mientras tú escribes. Eso es lo que ofrece Transformer Explainer, la herramienta interactiva de Georgia Tech que la comunidad de IA ha elegido como la mejor explicación visual de cómo funciona un LLM. No hay video que pausar ni paper que descifrar: el modelo se ejecuta directamente en tu navegador y te muestra lo que hace por dentro.

Si alguna vez te has preguntado qué significa exactamente que un LLM “predice el siguiente token” o qué hace la atención multi-cabezal más allá de lo que dice el diagrama del paper original, este artículo es para ti.

¿Cómo funciona realmente un transformer?

La arquitectura Transformer fue introducida en 2017 con el paper “Attention is All You Need”. Desde entonces, ha pasado de ser una propuesta técnica a ser la base de prácticamente todo lo que llamamos IA generativa: GPT, Llama, Gemini, Claude. Entender cómo funciona un Transformer es entender por qué estos modelos hacen lo que hacen, incluyendo por qué a veces se equivocan.

Transformer Explainer usa GPT-2 small (124 millones de parámetros) como modelo didáctico. No es el más potente, pero comparte los mismos principios arquitectónicos que los modelos de última generación. Aquí el proceso paso a paso:

- Tokenización: tu texto se divide en tokens, que pueden ser palabras completas o fragmentos de palabras. El vocabulario de GPT-2 tiene 50.257 tokens únicos. Cada token recibe un ID numérico.

- Embeddings: cada token se convierte en un vector de 768 dimensiones. Tokens con significados similares quedan cerca en ese espacio de alta dimensión. La matriz completa de embeddings tiene unos 39 millones de parámetros.

- Codificación posicional: el modelo necesita saber en qué posición está cada token dentro de la secuencia. GPT-2 aprende esta información durante el entrenamiento.

- Bloques Transformer: GPT-2 small tiene 12 bloques apilados secuencialmente. Cada bloque tiene dos partes: la atención multi-cabezal y una red MLP.

- Probabilidades de salida: el último bloque pasa por una capa lineal y una softmax que convierte los vectores en probabilidades sobre los 50.257 tokens del vocabulario.

El mecanismo de atención: por qué es tan poderoso

La atención es el corazón del Transformer. Su función es permitir que cada token “pregunte” al resto de la secuencia qué información necesita para ser representado mejor.

El mecanismo usa tres vectores derivados de cada token:

- Query (Q): es lo que el token está buscando. Piénsalo como la búsqueda que escribes en Google.

- Key (K): es lo que el token ofrece a los demás. Como el título de una página en los resultados de búsqueda.

- Value (V): es el contenido real del token, lo que se transfiere si la atención se activa. Como el texto de la página web una vez que haces clic.

GPT-2 small tiene 12 cabezales de atención por bloque. Cada uno aprende a detectar relaciones distintas: algunos captan dependencias sintácticas cercanas, otros rastrean referencias semánticas de largo alcance. Una máscara impide que un token “vea” los tokens futuros, lo que obliga al modelo a predecir sin hacer trampa.

La capa MLP que sigue a cada bloque de atención funciona de forma diferente: procesa cada token de forma independiente, expandiendo su representación de 768 a 3.072 dimensiones y luego comprimiéndola de vuelta. Este ciclo expansión-compresión permite capturar patrones más complejos que no serían visibles en el espacio original.

Por qué la temperatura importa más de lo que crees

Transformer Explainer incluye un control deslizante de temperatura que cambia directamente cómo el modelo elige el siguiente token. Este parámetro es uno de los menos comprendidos de los LLMs:

- Temperatura = 1: la distribución de probabilidades sin modificar. El modelo elige con la varianza que aprendió durante el entrenamiento.

- Temperatura baja (0.1-0.5): la distribución se vuelve más puntiaguda. El modelo se vuelve determinista, elige casi siempre el token más probable. Útil para tareas factuales.

- Temperatura alta (1.5-2.0): la distribución se aplana. El modelo se vuelve más “creativo” porque tokens menos probables tienen más chances de ser elegidos.

Combinado con top-k (limita a los k tokens más probables) y top-p (sampling nuclear), estos parámetros explican por qué el mismo prompt puede generar respuestas tan distintas en diferentes corridas.

Las otras grandes explicaciones visuales de LLMs

Transformer Explainer no es la única herramienta que hace esto bien. Si quieres ir más fondo:

- LLM Visualization de Brendan Bycroft — visualización 3D extremadamente detallada de cómo los pesos se activan capa por capa.

- 3Blue1Brown — Large Language Models explained briefly — animación concisa del Computer History Museum de San Francisco, el nivel de la explicación más accesible.

- The Illustrated Transformer de Jay Alammar — post clásico de 2018, todavía el más referenciado en papers académicos para explicar la arquitectura.

Para quien ya entiende la arquitectura pero quiere entender qué hace el modelo cuando falla, el método de detección de alucinaciones por “energía derramada” del Sapienza de Roma es una de las investigaciones recientes más interesantes sobre los mecanismos internos de los LLMs.

Por qué importa

La proliferación de herramientas de IA generativa en el trabajo hace que entender mínimamente cómo funcionan deje de ser un lujo académico. No necesitas saber multiplicar matrices para usar ChatGPT, igual que no necesitas entender combustión para manejar un auto. Pero saber que el modelo predice el siguiente token, que no “piensa” de forma lineal, que la temperatura cambia el tipo de respuestas que obtienes, que el contexto es finito: esas intuiciones cambian cómo promteas, cómo evalúas las respuestas y cuándo confías o no en el output.

El problema del código “plausible pero incorrecto” que generan los LLMs tiene raíz directa en esta arquitectura: el modelo optimiza para la coherencia estadística del texto, no para la corrección factual o lógica. Entender eso te hace mejor usuario de estas herramientas.

Transformer Explainer está disponible en poloclub.github.io/transformer-explainer. No necesita instalación, no requiere cuenta. Funciona en el navegador, y corre el modelo de verdad.