Cada vez que usas un LLM en la nube, hay algo que das por sentado: que internet va a estar ahí. Project N.O.M.A.D. (Network Offline Machine for Autonomous Defense) apuesta a lo contrario. Es un servidor de conocimiento e inteligencia artificial diseñado para funcionar sin conexión, sin telemetría y sin depender de ningún proveedor externo.

El proyecto es open source (licencia Apache 2.0), corre sobre Debian/Ubuntu y se instala con un solo comando. El resultado: un servidor local accesible desde el navegador con IA conversacional, Wikipedia offline, cursos de Khan Academy, mapas descargables y herramientas de análisis de datos. Todo dockerizado, todo dentro de tu red.

¿Qué incluye y cómo funciona?

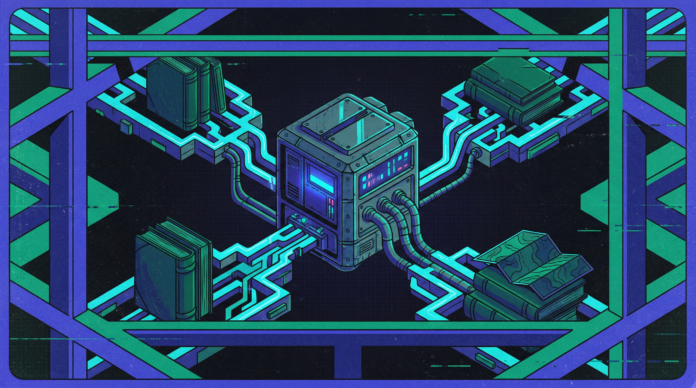

La arquitectura de NOMAD es un orquestador de contenedores (el “Command Center”) que gestiona un stack de herramientas probadas:

Claude Desbloqueado

Mi curso avanzado para aprender a sacarle mucho más provecho a Claude en el trabajo y en el día a día, con funciones y usos más potentes. Comienza el 23 de marzo.

→ Inscríbete hoy 🚀- IA local con RAG: motor de chat basado en Ollama, con búsqueda semántica sobre documentos propios vía Qdrant. Puedes subir tus archivos y el modelo los indexa para responder preguntas sobre ellos.

- Biblioteca de información offline: Wikipedia, manuales de salud, libros de supervivencia y guías técnicas descargables como archivos ZIM vía Kiwix.

- Plataforma educativa: cursos de Khan Academy con seguimiento de progreso a través de Kolibri.

- Mapas offline: regiones descargables con búsqueda y navegación vía ProtoMaps.

- Herramientas de datos: cifrado, análisis y encoding con CyberChef.

- Benchmark de hardware: puntuación del equipo con leaderboard comunitario.

Una vez instalado, NOMAD no necesita internet para nada. La única conexión requerida es durante la instalación inicial para descargar dependencias. Después, cero llamadas externas.

¿Para quién tiene sentido esto?

La pregunta honesta no es técnica: es sobre quién realmente necesita IA sin internet. Y la respuesta es más amplia de lo que parece.

Hay contextos obvios: zonas rurales con conectividad intermitente, operaciones de respuesta a emergencias, barcos, instalaciones industriales sin acceso a la nube pública. Pero también hay uno menos obvio: el usuario que simplemente no quiere que su asistente de IA le pase los datos a un servidor en otro país.

La tendencia de la IA local va en ascenso. Los AI PCs con NPU están democratizando la inferencia en el borde, y proyectos como el paper de Apple que demostró que modelos de 397B de parámetros pueden correr en un MacBook de 48 GB están redefiniendo qué se puede hacer sin GPU de datacenter. NOMAD empuja esa lógica más lejos: no solo IA local, sino IA local junto a todo el conocimiento que podrías necesitar.

Por qué importa

La narrativa dominante de la IA asume conectividad permanente. Los grandes modelos están en servidores remotos, el acceso es por API, y el conocimiento fluye hacia ti desde infraestructura que no controlas. NOMAD es una apuesta deliberada en dirección contraria.

No es la única. Proyectos como Kula (monitoreo de servidores sin dependencias ni bases de datos externas) comparten la misma filosofía minimalista: que los sistemas críticos no deberían depender de terceros para funcionar.

Lo que NOMAD propone tiene una implicación más profunda: que la inteligencia artificial debería poder ser tuya de verdad. No en el sentido de que la hayas entrenado, sino en el sentido de que corre en hardware que controlas, procesa lo que le das sin enviar nada afuera, y está disponible aunque Cloudflare caiga, aunque el ISP tenga un problema o aunque estés en un barco en mitad del Pacífico.

El hardware mínimo para la parte de IA (no la base del sistema, sino los LLMs) es considerable: 32 GB de RAM, GPU con suficiente VRAM, preferentemente SSD. No es un proyecto para hardware de bajo costo. Pero para quien ya tiene el hardware, el costo de entrar es prácticamente cero.

Puedes explorar el proyecto en projectnomad.us y el repositorio en GitHub.