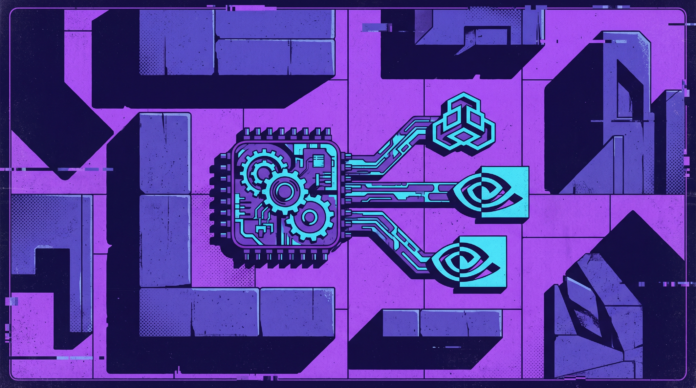

La escala de la inteligencia artificial en las empresas depende hoy, casi exclusivamente, de Kubernetes. Sin embargo, la gestión de GPUs dentro de estos contenedores ha sido históricamente rígida y opaca. NVIDIA ha dado un paso técnico significativo al donar el driver de Dynamic Resource Allocation (DRA) a la comunidad, permitiendo que las cargas de trabajo de IA compartan y utilicen recursos de hardware de forma mucho más flexible y granular.

Para quienes no operan directamente clusters de Kubernetes, la relevancia de DRA radica en la eficiencia de costos y el rendimiento operativo. Hasta ahora, asignar una GPU a una tarea solía ser un proceso de ‘todo o nada’. Con DRA, el orquestador puede repartir la potencia de procesamiento de manera dinámica según la demanda real, lo que reduce los cuellos de botella en la producción de modelos y permite arquitecturas de infraestructura más resilientes, similares a la segmentación que vemos en servicios como los tiers de Gemini API.

Por qué importa

NVIDIA integra la gestión de GPUs directamente en Kubernetes para cargas de IA, optimizando la infraestructura necesaria para escalar modelos en producción. Es un movimiento que elimina fricción técnica en la capa más baja de la computación moderna, facilitando que más empresas ejecuten IA sin el desperdicio de recursos tradicional y mejorando la transparencia en el uso del hardware.

Aprende IA con nosotros

Únete gratis a mi comunidad en Skool, donde compartimos noticias, tutoriales y recursos para seguir aprendiendo juntos.

👥 Únete gratis 🚀