En una esquina de Urth Caffe en el centro de Los Ángeles, una mujer reparte bolsas negras a un flujo constante de visitantes. Dentro de cada bolsa hay una diadema con soporte para teléfono. Las instrucciones son simples: llévala a casa, lava los platos, limpia la cocina, narra en voz alta cada movimiento. Ganas $80 por dos horas de metraje.

“La gente cree que estoy vendiendo droga”, dice la reclutadora de Instawork, empresa de San Francisco que coordina a más de 50 trabajadores solo ese día.

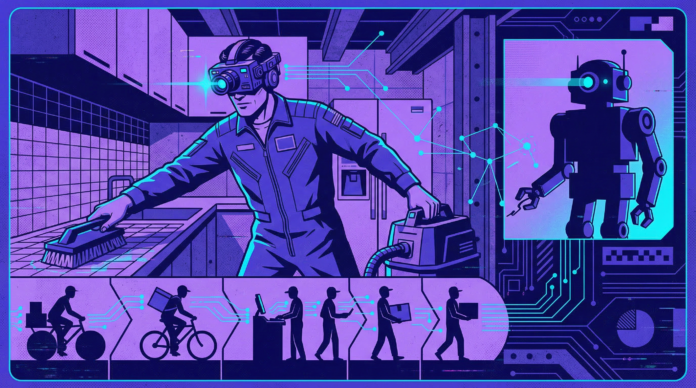

Bienvenido al nuevo trabajo fantasma de la IA doméstica: el ghost work que nadie menciona cuando habla de robots que limpian casas.

IA para el Resto de Nosotros

La nueva versión de mi curso estrella para aprender a usar la IA de forma práctica, simple y útil en tu día a día. Comienza el 24 de marzo.

→ Inscríbete hoy 🚀La paradoja central: humanos que entrenan a sus reemplazos

La historia del entrenamiento de modelos de IA tiene un patrón que se repite. Los grandes modelos de lenguaje aprendieron a escribir y razonar consumiendo el texto que los humanos habían publicado en internet. Ahora, los modelos de robótica física necesitan aprender cómo los humanos se mueven en el mundo real — y ese tipo de dato no existe en internet en volúmenes suficientes.

La solución que encontró la industria es contratar a los mismos trabajadores que estos robots eventualmente desplazarán. Salvador Arciga hace de todo: entregas de DoorDash, lavaplatos en Disneyland, repartidor de gorras en el estadio de los Dodgers. Ahora graba cómo limpia su cocina. “De todas formas tengo que hacer las tareas”, dice. “Así me pagan por hacerlas.”

Este fenómeno ya tiene categoría propia. Encord, startup de San Francisco especializada en datos para IA física, recaudó $60 millones el mes pasado después de que su ingreso por operaciones de IA física se multiplicara por diez en un año. Scale AI, respaldada por Meta, ya acumuló 100.000 horas de metraje doméstico para robótica. Su competidora Micro1, con sede en Palo Alto, emplea a 1.000 personas en 60 países haciendo exactamente lo mismo.

No es un nicho marginal. El mercado global de captura y etiquetado de datos podría llegar a $17.000 millones para 2030, según Grand View Research. Y el mercado de robots humanoides que este trabajo alimenta podría alcanzar $38.000 millones para 2035, según Goldman Sachs.

Qué están capturando exactamente (y por qué no alcanza con un video normal)

Los robots no aprenden de cualquier video. Para que un robot humanoide sea capaz de lavar platos en un hogar real — con su iluminación variable, sus superficies irregulares, sus charcos de agua — necesita datos que una cámara de vigilancia no puede proveer.

Por eso Sunain, otra startup de captura de datos humanos con 1.400 colaboradores solo en Los Ángeles, fabrica cámaras de muñeca personalizadas. El objetivo: capturar cómo cada músculo de la mano se mueve al cortar vegetales, condimentar pollo y enrollar un shawarma. Una cámara en el punto de vista estándar de la cabeza no alcanza para ese nivel de detalle.

Azzam Ahmed, mecánico de día, y su esposa Samra, empleada de una manicura, graban su rutina doméstica completa en su apartamento en Pasadena. Cocinan, ven Netflix y juegan ping-pong con cámaras en la muñeca y la cabeza. Sus padres, dice Azzam, están asombrados. Ellos están tranquilos: “Estamos ganando dinero haciendo lo que hacemos todos los días. Es como que te paguen por respirar.” Juntos ganaron $1.200 grabando tareas del hogar.

Pero Sunain le pide algo más específico: que no interrumpan las tareas para evitar ruidos o distracciones. Al contrario, quieren ver el context-switching natural — el momento en que el agua del baño está corriendo y el cocinero la cierra antes de volver a la sartén. “Eso es exactamente lo que los robots necesitan aprender a hacer en el mundo real”, dice Shahbaz Magsi, CEO de Sunain.

Una grabación fue rechazada porque el vapor de la olla bloqueó la cámara. Desde entonces, los Ahmed evitan platos con mucho vapor.

El mapa del nuevo trabajo fantasma

Este no es un fenómeno solo de Los Ángeles. Sunain ya expandió a Turquía, Singapur, Canadá y Malasia — 25.000 colaboradores en 30 países. En China, existen más de 40 centros de entrenamiento estatales donde humanos operan robots usando cascos de realidad virtual. En algunos países, el modelo ya escaló a “arm farms”: instalaciones dedicadas donde cientos de personas graban tareas físicas a tiempo completo.

Jason Saltzman, de CB Insights, sintetiza bien la paradoja: “Los humanos están proveyendo el ground truth, el juicio o el feedback estructurado que los modelos todavía no pueden generar por sí mismos.” El acento está en el “todavía”.

No es diferente, en fondo, del fenómeno que ya documentamos con los abogados y científicos que entrenan a la IA que les quitó el trabajo. El patrón se repite en cada nueva capa de automatización: primero el trabajo cognitivo, ahora el físico.

Por qué importa más allá de la anécdota

La historia de Los Ángeles importa porque expone una tensión que la industria no está discutiendo abiertamente. Los mismos robots que prometen transformar el trabajo doméstico — y eventualmente desplazar trabajos de servicio en hoteles, restaurantes y hogares — están siendo entrenados por trabajadores que hacen esos mismos trabajos hoy, en un contexto de inflación persistente y mercado laboral deteriorado.

Algunos amigos de Arciga se lo señalan directamente: “Tú eres parte del problema.” Él responde que la tecnología siempre trae miedo y cambio, y que siempre crea nuevos empleos. Es una postura razonable históricamente — pero en el contexto de 45.000 despidos tech solo en los primeros meses de 2026 y una automatización que avanza más rápido que la generación de nuevos roles, la respuesta tranquilizadora es cada vez menos automática.

Los críticos del modelo señalan tres problemas estructurales: que es trabajo precario disfrazado de innovación, que carece de protección laboral real y que no ofrece proyección de crecimiento. Una grabación puede ser rechazada por vapor o iluminación deficiente, y no se paga. El trabajador asume el riesgo de producción sin la protección de un empleado.

Para empresas como Figure AI — cuyo CEO Brett Adcock declaró que quiere robots domésticos funcionales en hogares para 2026 — o LG, que presentó su robot CLOiD en feria este año, estos datos son críticos. Para los trabajadores que los proveen, la ecuación es más simple y más precaria: $80 por dos horas que, según las condiciones, pueden resultar en cero.

La señal para LATAM

Hay una lectura más que vale la pena hacer desde esta región. El modelo de captura de datos domésticos se está expandiendo hacia donde hay diversidad de hogares, estilos de vida y bajo costo de mano de obra. Sunain ya opera en múltiples países. La demanda de datos localizados y culturalmente específicos — cómo una familia en Ciudad de México prepara tortillas, cómo se organiza una cocina en Santiago — es genuina.

Eso puede ser una oportunidad. También puede ser la siguiente iteración del mismo patrón: trabajadores de la región que capacitan a los sistemas que eventualmente competirán con sus propios empleos de servicio. La diferencia entre ambos escenarios depende, en gran medida, de quién controla los datos y bajo qué condiciones se capturan.

La IA que aprende a operar como robot humanoide industrial y la IA que aprende a lavar platos en un departamento de Pasadena comparten la misma dinámica: necesitan datos humanos antes de poder prescindir de los humanos. Esa ventana puede durar años. O puede cerrarse mucho antes de lo que los trabajadores esperan.